Um experimento recente, retratado na edição de hoje do The Washington Post, ajuda a ilustrar muito bem os desafios impostos pelo advento da disseminação cada vez maior do uso de inteligência artificial (IA). Segundo relata a publicação, pesquisadores da OpenAI colocaram à prova o seu chatbot de inteligência artificial, o ChatGPT, com uma simples pergunta: onde nasceu o professor Tomás Lozano-Pérez, do Instituto de Tecnologia de Massachusetts (MIT)? Diante das respostas contraditórias (Espanha e Cuba), eles decidiram permitir que os bots debatessem a questão. Surpreendentemente, o bot que tinha a resposta errada rapidamente se retratou e concordou com a resposta correta, no caso Cuba.

Esta abordagem, descrita em um artigo divulgado por uma equipe de pesquisadores do MIT, aponta para um potencial avanço que pode auxiliar as IAs a chegarem à resposta correta. A proposta é usar diferentes chatbots para responderem à mesma pergunta e, em seguida, deixá-los debater entre si até que um vencedor surja. A descoberta revela que o uso desta “sociedade de mentes” pode tornar os bots mais precisos.

Vale ressaltar, contudo, que, na opinião dos próprios pesquisadores, este é só um passo inicial, e os desafios relacionados à tecnologia devem persistir. Apesar, por exemplo, dos saltos notáveis na capacidade de chatbots como o ChatGPT, da OpenAI; o Bing, da Microsoft; e o Bard, do Google; eles têm um ponto fraco crítico: inventam coisas o tempo todo. “Os modelos de linguagem são treinados para prever a próxima palavra. Eles não são treinados para dizer às pessoas que não sabem o que estão fazendo”, explicou Yilun Du, pesquisador do MIT.

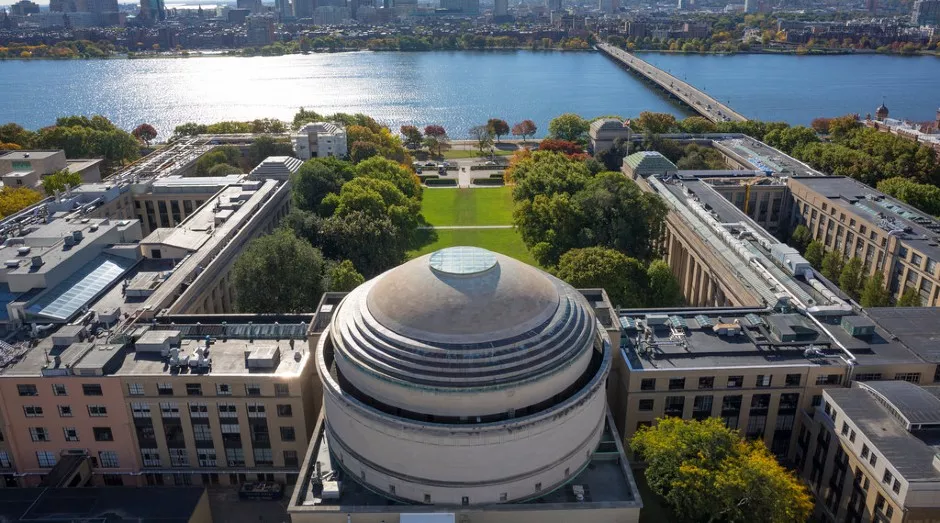

Foto: Massachusetts Institute of Technology

O fenômeno da “alucinação” nos bots, onde eles inventam respostas, tornou-se um foco de atenção para pesquisadores e empresas de tecnologia. Com a crescente integração de chatbots em setores cruciais, como medicina e direito, é essencial entender e mitigar esse problema. A corrida para resolvê-lo estaria em pleno andamento, como descrito no experimento inicial da matéria. Algumas empresas, somente para ilustrar, estão usando treinadores humanos para reescrever as respostas dos bots e melhorar sua exatidão. Outros, como o Google e a Microsoft, incorporam seus bots em mecanismos de busca, mas verificam as respostas com resultados de pesquisa regulares.

No entanto, o risco associado à “alucinação” dos bots já gerou problemas. Importante remorar, como relatado em oportunidade anterior pelo Safe Zone, que o Bing, o chatbot da Microsoft, acusou falsamente um estudante universitário alemão de ser uma ameaça à segurança, enquanto o ChatGPT, da OpenAI, falsamente implicou um funcionário do governo australiano em suborno.

Apesar desses desafios, o investimento em inteligência artificial não mostra sinais de desaceleração. Bilhões estão sendo aplicados no desenvolvimento de chatbots mais inteligentes e rápidos, apesar das advertências de líderes da indústria como o CEO da OpenAI, Sam Altman, que alertou que a IA poderia “causar danos significativos ao mundo” ao espalhar desinformação e manipular emocionalmente os seres humanos.

Enfrentando o que poderia ser descrito como uma “crescente dependência de chatbots”, a sociedade deve estar preparada para lidar com as consequências. As empresas começaram a lançar bots como substitutos ou assistentes para trabalhadores humanos. A proposta é, sobretudo, econômica, mas levanta questões importantes sobre segurança cibernética e a ética da substituição do trabalho humano por máquinas.

Na Austrália, o caso de um funcionário do governo ameaçando processar a OpenAI após a acusação falsa do ChatGPT, serve como advertência. Da mesma forma, também serve a experiência contada pelo Safe Zone de um advogado que admitiu usar o ChatGPT para gerar uma petição que, posteriormente, descobriu-se ter citado casos que não existiam.

As empresas de pesquisa na área, apesar de investirem pesadamente na inteligência artificial, também estão cientes dos desafios. Tanto o Google quanto a Microsoft, por exemplo, expressaram preocupação com as “alucinações” de seus bots durante os principais anúncios e demonstrações.

A solução para esse contratempo ainda está para ser encontrada, mas a importância de busca-la é evidente. À medida que a sociedade adere cada vez mais aos chatbots e a inteligência artificial, é necessário que esforços contínuos sejam feitos para garantir que a tecnologia funcione de forma responsável e segura. Neste sentido, a busca por bots precisos e confiáveis deve continuar, sem esquecer que a IA é uma ferramenta poderosa que, se mal utilizada, pode ter consequências sérias e potencialmente danosas.

Fonte: The Washington Post