A ascensão da inteligência artificial tem sido inegável, como exemplificado pela popularidade vertiginosa de aplicativos como o ChatGPT, desenvolvido pela OpenAI. No entanto, este é, aparentemente, apenas o começo de uma revolução tecnológica que pode alterar completamente a sociedade, a economia e até mesmo a existência humana. O medo decorre dos dois estágios avançados de inteligência artificial, segundo publicou recentemente a BBC Brasil: a Inteligência Artificial Geral (AGI) e a Superinteligência Artificial (ASI).

O que é Inteligência Artificial Geral?

Os programas de inteligência artificial atualmente em uso, como ChatGPT, são classificados como Inteligência Artificial Estreita (ANI) – capazes de executar tarefas específicas, mas sem autoconsciência ou a capacidade de operar fora dos limites definidos por seus programadores. Contudo, a Inteligência Artificial Geral, ou AGI, representa um salto considerável nesse processo. A AGI será capaz de realizar, por exemplo, qualquer tarefa intelectual que um humano pode fazer. Esse conceito é tão desafiador que mais de mil especialistas em tecnologia pediram, em março passado, como registrado na oportunidade pelo Safe Zone, uma moratória no treinamento de sistemas de IA mais poderosos do que o GPT-4.

Sobre a Superinteligência Artificial

A ASI é a fase final do desenvolvimento da IA, na qual a inteligência sintética supera a inteligência humana. Teóricos sugerem que uma vez que uma máquina alcance a inteligência humana, sua capacidade de aprender de forma autônoma permitirá que ela nos supere em pouco tempo, atingindo a Superinteligência Artificial. Esse cenário tem provocado tanto medo quanto fascínio entre os pesquisadores.

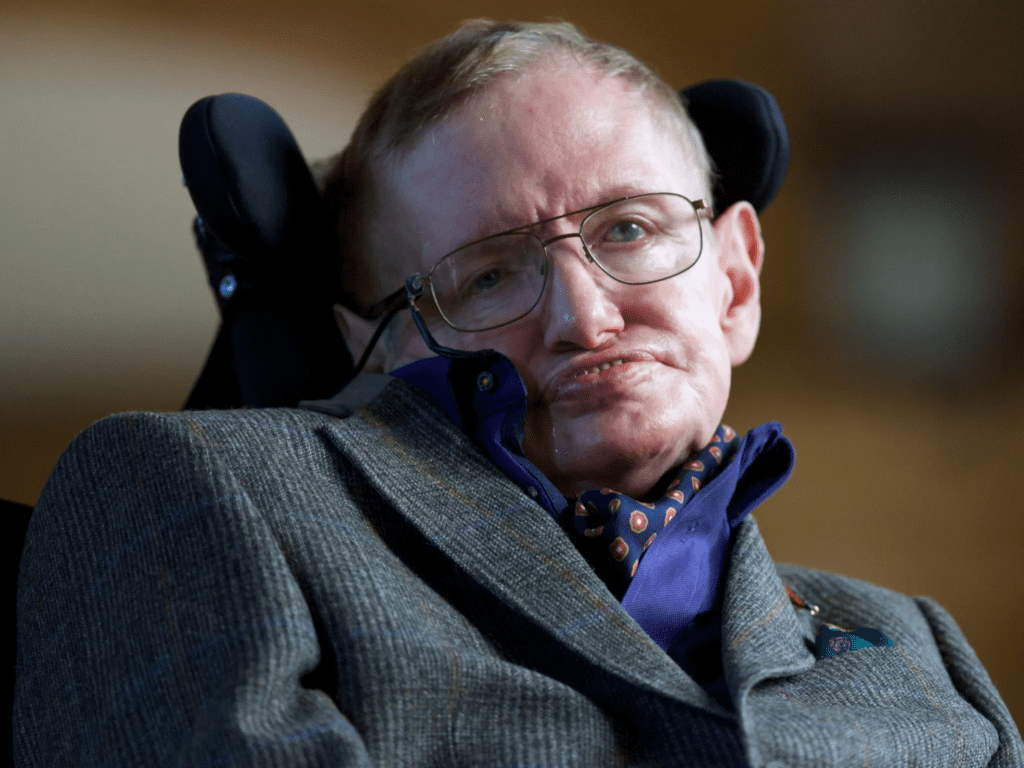

Stephen Hawking, famoso físico britânico, considerava a ASI uma ameaça à existência humana, enquanto Ray Kurzweil, autor e inventor futurista, prevê que a ASI poderá superar nossas limitações biológicas, melhorando nossas vidas e talvez até alcançar a imortalidade.

Stephen Hawking (Foto: Reprodução)

Os riscos da AGI e ASI são consideráveis. O conceito de máquinas com inteligência super-humana levanta questões profundas sobre controle, ética, segurança e igualdade. Como podemos garantir que essas superinteligências sejam seguras e usem suas capacidades de maneira benéfica? Como evitamos a obsolescência humana? Esses são os problemas que fazem com que a AGI e a ASI provoquem tanto medo.

Tais dilemas, como é possível imaginar, exigem uma ampla discussão pública e regulamentações claras. Embora a IA possa representar uma ferramenta poderosa para resolver problemas complexos, é crucial que a humanidade enfrente essas questões difíceis para garantir que seu desenvolvimento seja seguro e beneficie a todos.

Fonte: BBC Brasil